Le coût du Shadow AI : Comment gérer le risque IA dans un paysage en mutation

Vos collaborateurs utilisent des outils d'IA que votre équipe de sécurité ne connaît pas. Sans politiques claires, le Shadow AI se propage de manière incontrôlée dans votre organisation. Cet article analyse ce qu'il coûte, pourquoi il se propage et comment gérer votre exposition grâce au framework FAIR.

.png)

Qu'est-ce que le Shadow AI ?

Le Shadow AI désigne l'utilisation d'outils d'intelligence artificielle, y compris l'IA générative, par des collaborateurs sans la connaissance, l'approbation ou la supervision des équipes IT ou de sécurité.

En quoi le Shadow AI diffère-t-il du Shadow IT ?

Le Shadow AI est une évolution plus spécifique du Shadow IT, la pratique ancienne consistant à utiliser des technologies non approuvées au travail. La différence essentielle réside dans la nature du risque. Le Shadow IT peut conduire des collaborateurs à divulguer des données sensibles ou de la propriété intellectuelle (IP) via un chatbot public, ou à s'appuyer sur un outil alimenté par l'IA pour une tâche critique sans supervision, sans audit et sans moyen de reconstituer ce qui s'est passé.

Le coût métier d'une IA non maîtrisée

Lorsqu'un collaborateur copie-colle un contrat client confidentiel dans une session ChatGPT publique, les données de votre client et votre réputation sont immédiatement exposées.

Le rapport IBM Cost of a Data Breach 2025 indique que le Shadow AI a été un facteur dans une violation sur cinq étudiées, ajoutant en moyenne 670 000 $ de coûts supplémentaires par rapport aux organisations avec peu ou pas de Shadow AI. Cela fait de l'IA non gouvernée l'un des trois facteurs de violation les plus coûteux de l'année. Par ailleurs, 97 % des organisations ayant subi un incident de sécurité lié à l'IA manquaient de contrôles d'accès appropriés, et 63 % n'avaient aucune politique de gouvernance IA.

Les raisons de la propagation du Shadow AI dans votre organisation

Le Shadow AI n'est pas, pour l'essentiel, le résultat d'une intention malveillante. Les collaborateurs utilisent ces outils parce qu'ils souhaitent améliorer la qualité de leur travail ou augmenter leur productivité.

La GenAI est intégré dans les outils que vos collaborateurs utilisent déjà

De nombreux outils d'IA générative sont librement disponibles, basés sur navigateur ou intégrés dans des produits SaaS que vos collaborateurs utilisent quotidiennement. Microsoft 365, Google Workspace, Notion, Slack et des centaines d'autres plateformes ont intégré des fonctionnalités IA dans leurs abonnements existants. Comme ces capacités arrivent au sein d'applications déjà approuvées, elles déclenchent rarement l'examen qu'impose l'adoption d'un nouvel outil. Les équipes IT et de sécurité ont besoin de politiques qui régissent non seulement les nouveaux logiciels, mais aussi les nouvelles fonctionnalités IA intégrées dans les outils existants.

La plupart des organisations n'ont toujours pas de politique de gouvernance IA

63 % des organisations n'ont pas du tout de politique de gouvernance IA ou sont encore en train de les élaborer. Lorsqu'aucune politique d'utilisation de l'IA n'existe, les collaborateurs prennent leurs propres décisions.

Le résultat est prévisible. Au moment où une équipe de sécurité met en place une politique d'utilisation de l'IA, des dizaines d'outils GenAI sont déjà utilisés dans des workflows actifs.

Les risques de cybersécurité liés au Shadow AI

Le Shadow AI n'introduit pas de nouvelles catégories de risques. Il accélère les défaillances de cybersécurité connues, simplement via une nouvelle interface. Au fond, le risque IA concerne toujours la protection des données, des systèmes et de l'intégrité décisionnelle.

Exposition des données et manquements à la conformité

- Traitement non autorisé des données : Les collaborateurs collent des données sensibles dans des outils IA publics, où elles peuvent être conservées, journalisées ou utilisées pour l'entraînement.

- Non-conformité réglementaire : RGPD, l'EU AI Act, DORA et NIS2 imposent des exigences strictes sur le traitement des données. L'utilisation non sanctionnée de l'IA crée des lacunes difficiles à auditer ou à justifier.

- Absence d'audit trail : Les décisions assistées par IA ne laissent souvent aucune trace des entrées, sorties ou actions des utilisateurs, rendant difficile l'investigation des incidents et la responsabilisation.

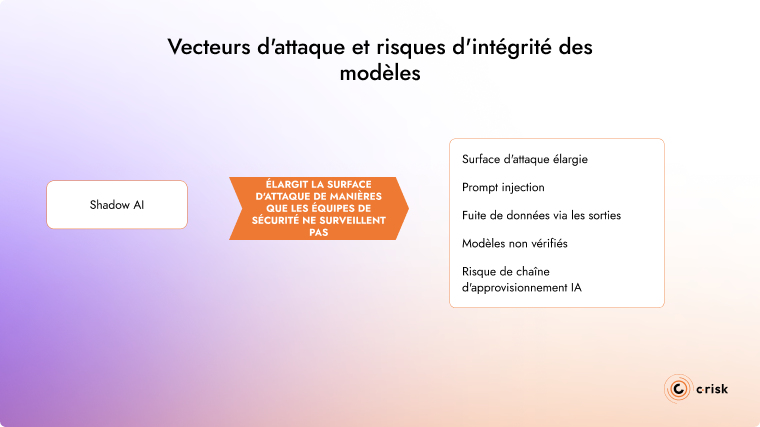

Vecteurs d'attaque et risques d'intégrité des modèles

Le Shadow AI élargit la surface d'attaque de manières que les équipes de sécurité ne surveillent pas :

- Surface d'attaque élargie : Les outils, APIs et plug-ins non approuvés créent des points d'entrée non gérés dans les données de l'entreprise

- Prompt injection : Des entrées malveillantes manipulent les modèles pour divulguer des données ou effectuer des actions non prévues

- Fuite de données via les sorties : Des informations sensibles peuvent être exposées à travers les réponses générées

- Modèles non vérifiés : Des données d'entraînement et des comportements inconnus introduisent des risques de biais, d'hallucination ou d'exposition cachée de données

- Risque de chaîne d'approvisionnement IA : Des outils tiers ou des intégrations compromis peuvent devenir une voie d'accès aux systèmes internes

Comment le Shadow AI conduit à la dérive organisationnelle

La dérive organisationnelle est ce qui transforme l'IA approuvée en Shadow AI au fil du temps. C'est ce qui fait de la dérive organisationnelle un défi particulier dans la gouvernance IA. Le profil de risque d'un outil au moment de son déploiement n'est pas le même six ou douze mois plus tard.

Les outils IA basés sur SaaS déploient continuellement de nouvelles fonctionnalités. Un outil évalué et approuvé pour un cas d'usage peut silencieusement acquérir la capacité de traiter des types de données supplémentaires, de se connecter à des services tiers ou de fonctionner de manière plus autonome. Si ces changements ne font pas l'objet d'une réévaluation, l'organisation fait effectivement fonctionner un outil non révisé dans un cadre approuvé.

Dans le même temps, de nouveaux collaborateurs rejoignent l'équipe. Et sans formation continue à la sensibilisation cyber couvrant spécifiquement les outils IA et les usages acceptables, le personnel peut ne pas savoir ce qui relève de la politique et ce qui n'en relève pas. Un développeur recruté après la dernière mise à jour de la politique IA n'a aucun moyen fiable de savoir ce qui est approuvé ou non, à moins que cette information ne lui soit explicitement communiquée.

C'est là que les responsables de la gouvernance et les responsables des risques doivent travailler de concert. Les équipes de gouvernance doivent communiquer les changements de politique clairement et régulièrement, pas seulement les publier. Les équipes risques doivent rester à jour sur le paysage de l'IA générative, en suivant l'évolution des outils et les nouvelles capacités ou intégrations susceptibles de modifier l'exposition des outils déjà en usage. Une évaluation des risques IA n'est pas un exercice ponctuel. Le paysage qu'elle était censée refléter évolue en permanence.

Comment évaluer et gérer le risque Shadow AI : un framework en 5 étapes

L'évaluation du risque IA suit la même structure que toute évaluation du risque technologique ou cyber : identifier les actifs, définir les scénarios de menace, évaluer les contrôles en place et quantifier l'exposition. Le premier défi est que l'« IA » n'est pas une technologie unique. Les LLMs, l'IA générative multimodale, les fonctionnalités IA intégrées dans les produits SaaS et les déploiements personnalisés basés sur API ont chacun des capacités, des flux de données et des surfaces de menace différents, de sorte que le périmètre de l'évaluation des risques IA doit refléter la technologie spécifiquement utilisée.

Le FAIR Institute a développé une méthode basée sur le standard FAIR pour l'IA, appelée FAIR-AIR. FAIR-AIR utilise un framework en cinq étapes :

1. Contextualiser

Établissez pourquoi vous réalisez cette évaluation et ce qui la motive. La pression réglementaire, un incident récent, un nouveau déploiement IA ou un audit à venir entraînent tous des priorités différentes en matière de périmètre d'analyse et des définitions différentes de ce qu'est un événement entraînant une perte significative.

2. Délimiter vos scénarios de risque

Pour chaque déploiement IA, identifiez la surface d'attaque, les acteurs de menace plausibles, la méthode d'attaque et l'actif exposé. Les scénarios Shadow AI se regroupent typiquement autour de trois domaines de la triade CIA : confidentialité (fuite de données via un LLM public, prompt injection), intégrité (empoisonnement de modèle, sorties biaisées ou manipulées) et disponibilité (dépendance à un service IA tiers sans solution de repli).

3. Identifier les actifs critiques exposés

Pour chaque scénario, déterminez à quelles données l'outil peut accéder ou qu'il peut recevoir en entrée : données personnelles, dossiers clients, code source, informations financières, stratégie interne. La sensibilité des actifs détermine la sévérité de l'exposition et oriente la priorisation des scénarios.

4. Quantifier avec FAIR

En utilisant le framework FAIR™, chaque scénario de menace produit une gamme de résultats financiers probables, incluant la fréquence d'occurrence, la perte attendue par événement et la perte maximale plausible. Cela donne à la direction une base de prise de décision que les évaluations haut/moyen/bas ne peuvent pas fournir.

5. Prioriser et décider

Sur la base de l'exposition quantifiée, identifiez quels contrôles offrent la meilleure réduction du risque par euro investi, que ce soit en déployant un LLM privé, en imposant la classification des données avant l'utilisation d'outils IA, en mettant en place des politiques DLP spécifiques à l'IA ou en renforçant les contrôles d'accès. Le résultat n'est pas seulement une liste priorisée : c'est une recommandation défendable sur la marche à suivre et les investissements à réaliser.

C-Risk aide les responsables de la sécurité et des risques à évaluer et quantifier leur risque GenAI et Shadow AI grâce au framework FAIR™, en traduisant l'exposition en termes financiers qui orientent les décisions et convainquent les conseils d'administration.

Si vous déployez une nouvelle initiative IA ou un outil numérique et que vous avez besoin de comprendre comment il remodèle votre paysage de risques avant sa mise en production, C-Risk réalise des évaluations de risques quantifiées pour les nouvelles initiatives numériques qui donnent aux parties prenantes projet et sécurité une vision commune et financièrement fondée des risques impliqués.

Qu'est-ce que le Shadow AI ?

Le Shadow AI est l'utilisation d'outils IA par des collaborateurs sans la connaissance ou l'approbation des équipes IT ou de sécurité.

Quelle est l'étendue du Shadow AI ?

Selon le rapport IBM Cost of a Data Breach 2025, le Shadow AI était impliqué dans 20 % des violations étudiées, et 63 % des organisations touchées ne disposaient pas de politiques de gouvernance IA, ce qui signifie que la majorité n'exerce aucune supervision structurée sur l'utilisation interne des outils IA.

Quelles données sont les plus exposées par le Shadow AI ?

Toutes les données que les collaborateurs peuvent facilement copier-coller dans des outils IA notamment les données clients, le code source, les documents de stratégie interne, les informations financières et les dossiers RH, ainsi que les données protégées par des réglementations comme GDPR, DORA et NIS2.

Articles associés

En savoir plus sur les risques cyber, les attaques par ransomware, la conformité réglementaire et la cybersécurité.

.svg)

.png)

.png)